图解《互联网信息服务深度合成管理规定》学习解读

随着人工智能技术的飞速发展,深度合成技术(通常指利用深度学习、虚拟现实等技术生成或编辑文本、图像、音频、视频等内容的技术)在互联网信息服务领域得到了广泛应用,从娱乐滤镜、虚拟主播到智能客服、内容创作,其影响力日益扩大。为了规范这一技术的应用,防范安全风险,保护公民、法人和其他组织的合法权益,维护国家安全和社会公共利益,国家互联网信息办公室等相关部门联合发布了《互联网信息服务深度合成管理规定》(以下简称《规定》)。以下是对该《规定》的图解式学习解读。

一、 《规定》的总体目标与适用范围

- 核心目标:促进深度合成服务健康有序发展,明确提供者和使用者的责任义务,划清技术应用的“红线”与“底线”。

- 适用范围:在中华人民共和国境内应用深度合成技术提供互联网信息服务(即“深度合成服务”)的活动,以及相关的监督管理。

二、 深度合成服务提供者的核心责任义务(“做什么”与“不做什么”)

- 主体责任落实:建立健全管理制度,制定管理规则,加强技术管理,对生成内容进行审核。

- 真实身份认证:按照《网络安全法》要求,对深度合成服务使用者进行真实身份信息认证。

- 显著标识义务:对使用深度合成技术生成的或编辑的信息内容,必须进行显著标识(如添加水印、标签等),避免公众混淆。这是《规定》的一大亮点和核心要求。

- 信息内容管理:建立健全用于识别违法和不良信息的特征库,加强内容管理,发现违法和不良信息应立即处置。

- 数据安全与个人信息保护:依法履行个人信息保护义务,建立健全训练数据管理、个人信息保护等制度。

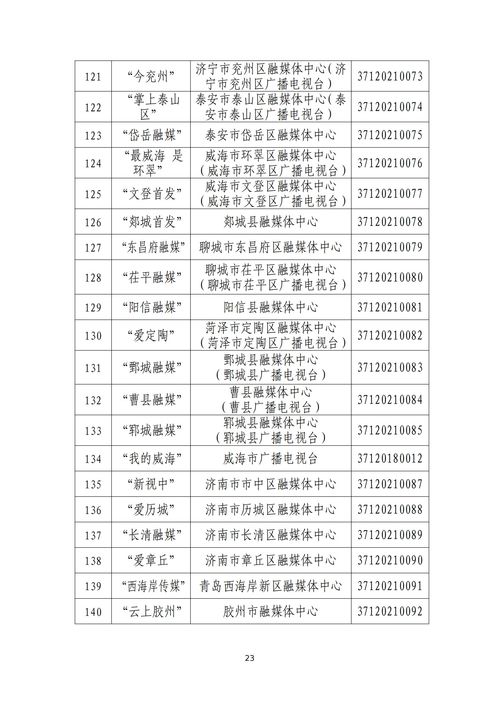

- 安全评估与备案:具有舆论属性或者社会动员能力的深度合成服务提供者,应按规定开展安全评估,并履行备案手续。

- 辟谣机制:发现利用深度合成服务从事违法活动或传播虚假信息的,应及时采取辟谣、处置等措施。

- 禁止行为红线:不得利用深度合成服务从事法律、行政法规禁止的活动,不得制作、复制、发布、传播违法和不良信息。

三、 深度合成服务使用者的行为规范

- 依法依规使用:遵守法律法规,尊重社会公德和伦理,不得利用深度合成服务从事危害国家安全、损害公共利益、侵害他人合法权益等活动。

- 真实信息提供:提供真实身份信息进行认证。

- 不得恶意规避:不得故意规避、对抗深度合成服务提供者采取的管理措施。

四、 监督管理和法律责任

- 监管部门:国家及地方网信部门依法负责统筹协调监督管理工作,电信、公安、市场监管等部门依据职责实施监督管理。

- 监督检查权:监管部门可依法对深度合成服务开展监督检查,服务提供者应予以配合。

- 违法责任:违反《规定》的,将依据《网络安全法》、《数据安全法》、《个人信息保护法》等法律法规进行处罚;构成犯罪的,依法追究刑事责任。

五、 《规定》的重要意义与行业影响

《规定》的出台标志着我国在人工智能治理领域迈出了关键一步,为深度合成技术的应用确立了清晰的规则框架。

- 对行业:促使技术研发和应用企业将合规与伦理要求前置,推动技术向善,实现创新与规范的平衡发展。

- 对公众:增强了网络空间内容的可辨识度,有助于防范“深度伪造”等带来的诈骗、诽谤、混淆视听等风险,提升了网络信息环境的安全性与可信度。

- 对社会:为维护网络空间清朗、保障国家安全和社会稳定提供了有力的制度工具,是构建清朗网络空间的重要组成部分。

****:《互联网信息服务深度合成管理规定》以技术治理技术,以规范引导发展,通过明确责任、强化标识、加强管理等一系列措施,为深度合成技术的健康发展保驾护航,是引导互联网信息服务,特别是新兴AI应用走向规范化、法治化轨道的重要里程碑。所有相关服务提供者与使用者都应深入学习、严格遵守,共同营造一个安全、可靠、清朗的网络人工智能应用生态。

如若转载,请注明出处:http://www.huoqufu.com/product/67.html

更新时间:2026-05-25 09:09:35